近年來人工智能在醫療服務領域應用愈發廣泛,基于人工智能的臨床決策輔助系統是其主要應用形式之一。基于人工智能臨床決策輔助系統的早期臨床評價介于臨床前開發(計算機模擬)、離線驗證和臨床試驗之間,但目前少有人工智能相關臨床研究涉及人因學評價,且缺少與人工智能系統運行環境、用戶特征、選擇過程及算法識別等方面的報告。為縮小人工智能輔助決策系統在開發與實際臨床應用間的差距,提高人工智能系統臨床研究的透明性和規范性,2022年,BMJ發表了基于人工智能的臨床輔助決策系統早期臨床評價研究的報告規范(DECIDE-AI)。本文就指南的制訂背景、制訂過程和重點內容進行解讀,以期促進該報告規范在國內研究人員中的理解與應用。

引用本文: 陳濘夙, 趙凱, 薛心雨, 齊亞娜, 喻佳潔. 基于人工智能的臨床輔助決策系統早期臨床評價研究的報告規范(DECIDE-AI)解讀. 中國循證醫學雜志, 2024, 24(9): 1100-1107. doi: 10.7507/1672-2531.202401188 復制

版權信息: ?四川大學華西醫院華西期刊社《中國循證醫學雜志》版權所有,未經授權不得轉載、改編

1 DECIDE-AI的制訂背景

近年來,人工智能(artificial intelligence,AI)在醫療服務領域的應用愈發廣泛,基于AI的臨床決策輔助系統(以下簡稱“AI系統”)是其主要應用形式之一。研究表明:AI系統在臨床前開發階段或計算機生物模擬階段已展現出可比擬人類專家的良好性能[1],但少有證據證明其在臨床實際應用中能改善醫生活動和患者結局[2,3]。目前,AI系統的開發與應用間尚存在的“AI鴻溝”[4],即主要強調人工智能算法的數學性能,忽略了人工智能系統、用戶和實施環境間相互作用對其實際應用的影響。將人工智能系統從數學性能提升到臨床效果,需開展循序漸進的實施和評估,解決其相互作用的復雜問題。

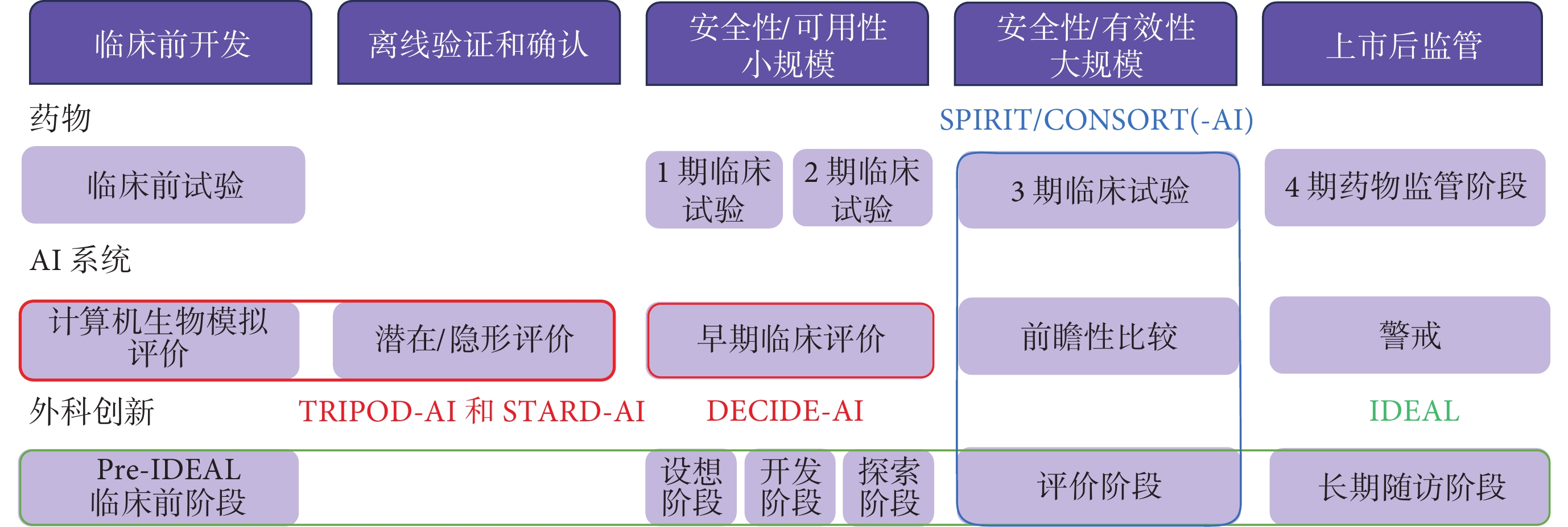

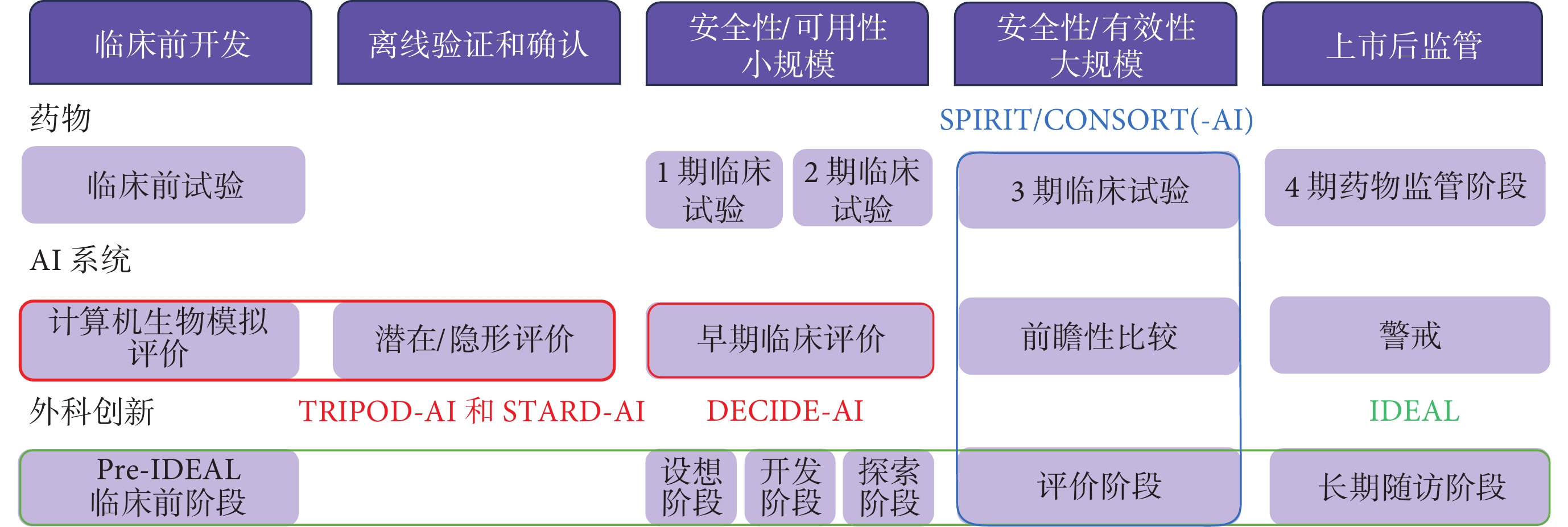

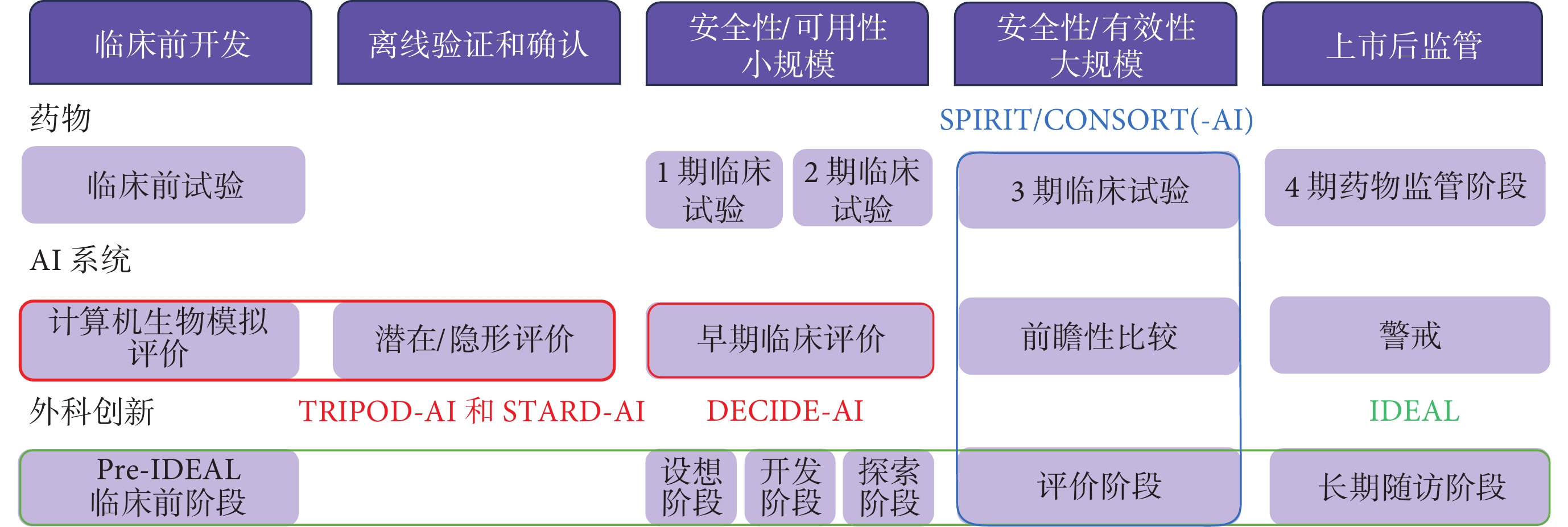

AI系統的早期臨床評價介于臨床前開發(計算機模擬)、離線驗證和臨床試驗之間,類似于外科領域IDEAL框架的stage 1(設想)、2a(開發)或2b(探索)[5,6],或藥物臨床試驗的1期與2期臨床試驗(圖1),關注AI系統的實際臨床性能、安全性和人因學評價(human factors)。但目前少有AI系統臨床研究涉及人因學評價,且可用性評估方法不一致。另外,也缺少AI系統運行環境、用戶特征、選擇過程及算法識別等方面的報告。

圖1

藥物、醫療衛生領域中人工智能和外科創新的發展路徑比較

圖1

藥物、醫療衛生領域中人工智能和外科創新的發展路徑比較

彩色線條代表報告指南,其中部分是針對特定研究設計的(TRIPOD-AI、STARD-AI、SPIRIT/CONSORT、SPIRIT/CONSORT-AI),部分是針對特定階段的(DECIDE-AI、IDEAL)。

為提高AI系統臨床研究的透明性和規范性,國際上已相繼制訂和發布相關報告規范,如:用于報告診斷或預后預測模型開發、驗證和更新的TRIPOD-AI[7];用于報告診斷準確性研究的STARD-AI[8];分別用于報告評價隨機對照試驗及計劃書的CONSORT-AI[9]和SPIRIT-AI[10](圖1),但AI系統早期臨床評價階段的報告規范仍存在空白。為改善實踐中此類研究報告不充分的問題,2022年5月,Vasey等[11]在BMJ發表了人工智能驅動下決策輔助系統早期臨床評價的報告指南(reporting guideline for the developmental and exploratory clinical investigations of decision support systems driven by artificial intelligence,DECIDE-AI)。本文就指南的制訂過程和主要內容進行解讀,以期促進報告指南的正確理解和使用。

2 DECIDE-AI的制訂過程

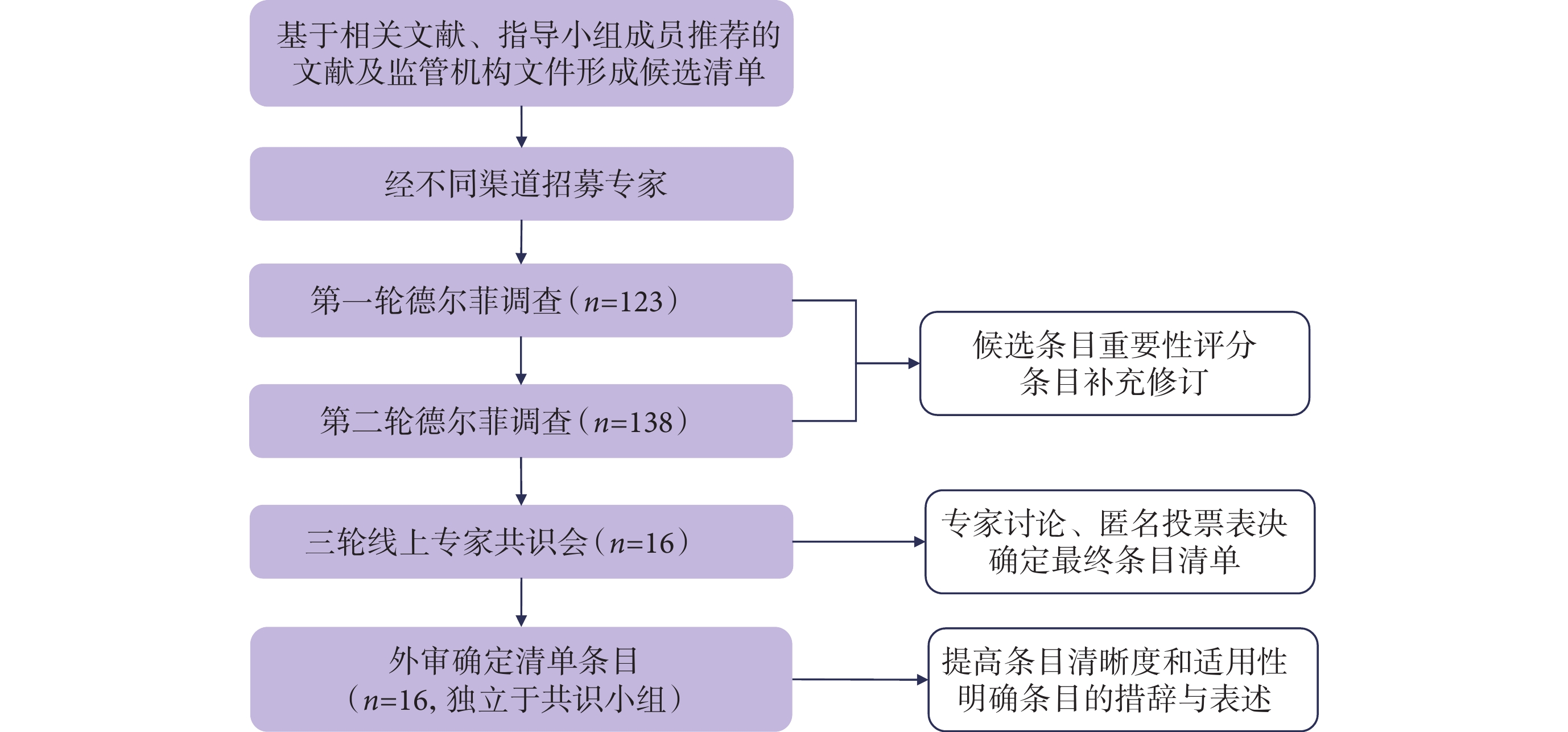

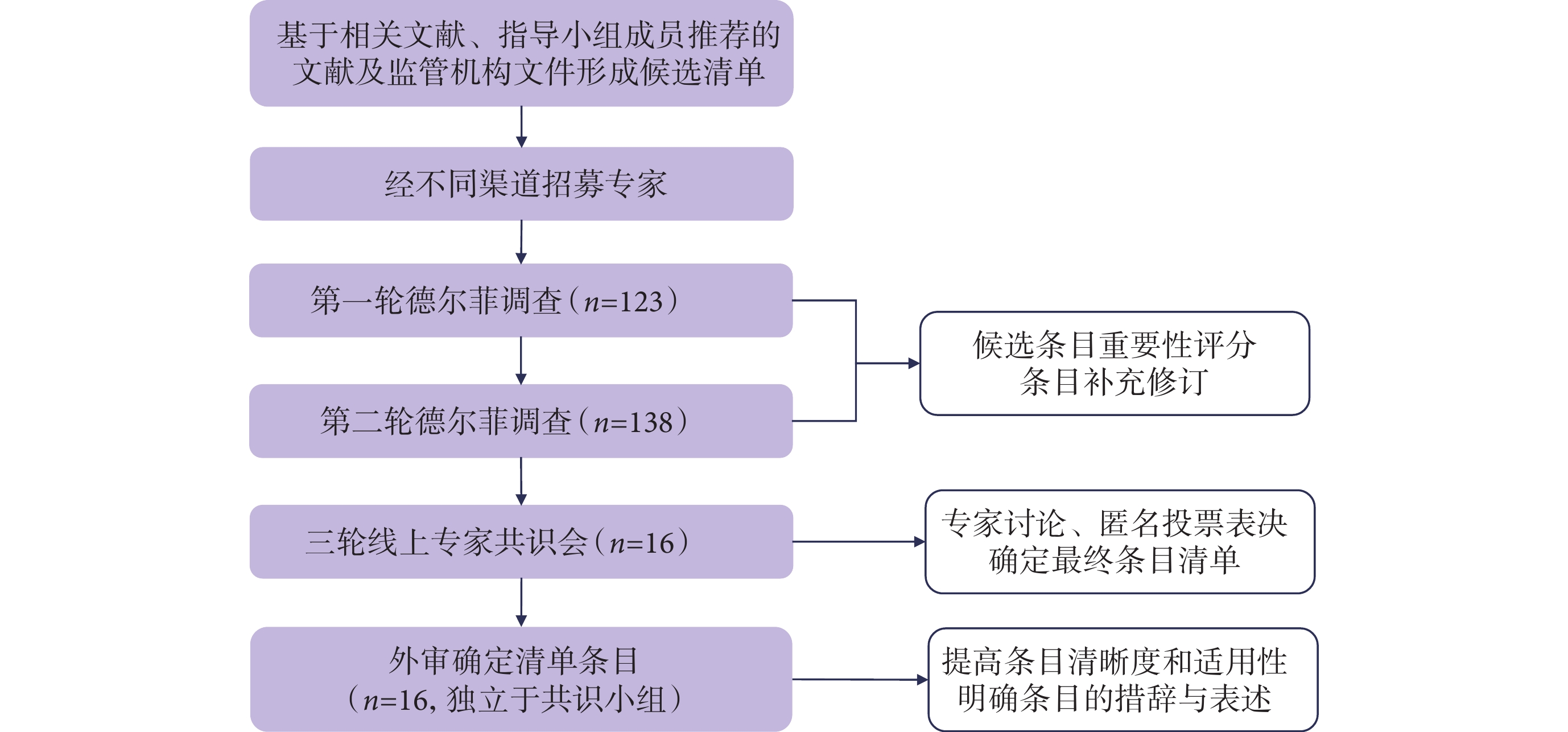

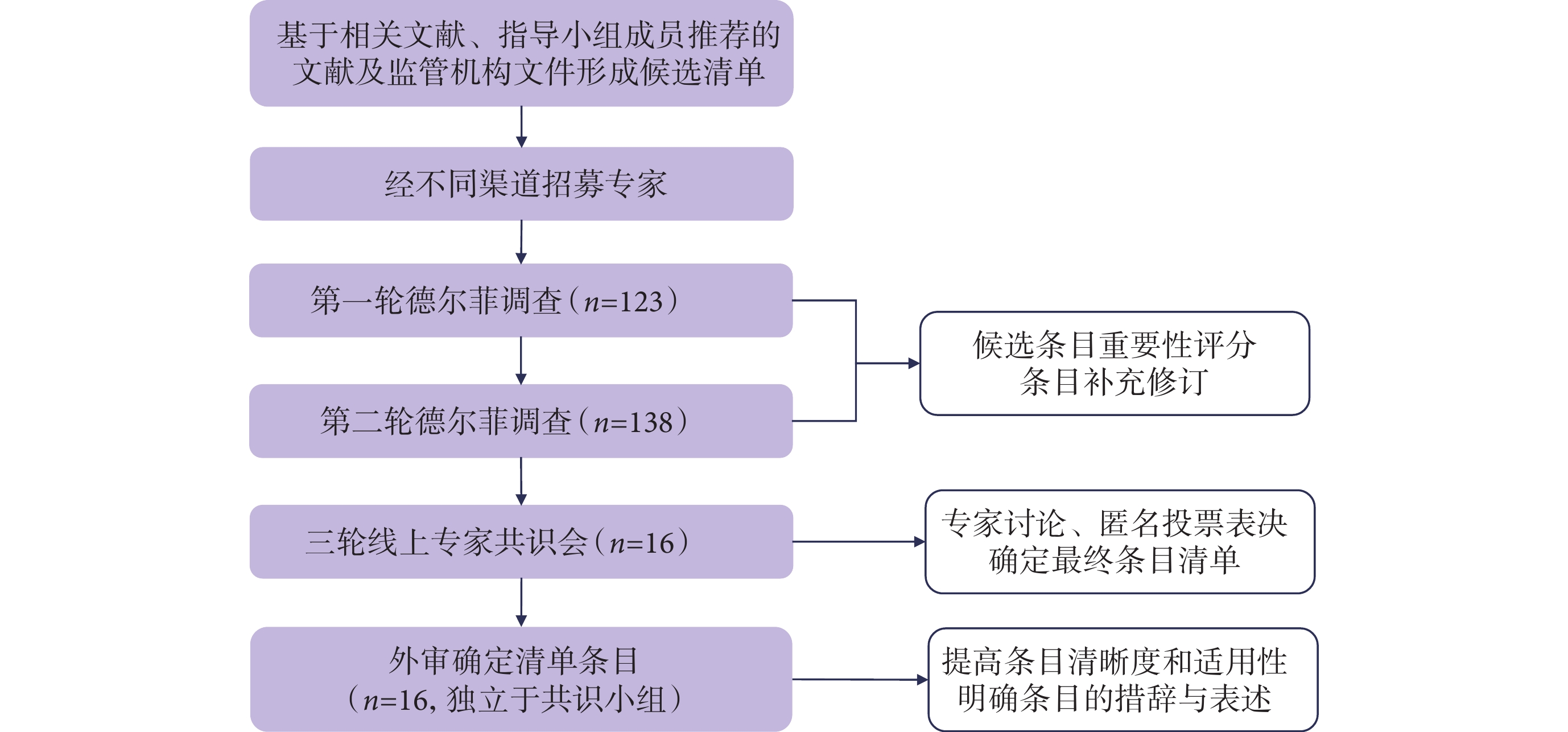

DECIDE-AI的制訂參考EQUATOR協作網指南制訂的基本流程進行,有專門的指導小組監督指南的制訂過程[12],見圖2:① 基于專家意見制訂了初步的候選清單,該清單重點參考了基于人工智能診斷決策輔助系統的相關文獻、指導小組成員推薦的文獻及監管機構文件;② 通過不同的渠道招募專家,包括:指導小組推薦的專家、檢獲文獻的作者、任何主動聯系指導小組的專家及德爾菲專家推薦的專家(滾雪球),最終招募了行政人員/醫院管理人員、醫療專業人員、臨床醫生、工程師/計算機科學家、人因設計專家、流行病學家、倫理學家、期刊編輯、患者代表等來自18個國家的20類利益相關群體參與;③ 開展兩輪改良德爾菲專家咨詢形成初步條目,138名專家同意參加首輪德爾菲調查,其中123名(89%)完成了調查問卷,162名專家受邀參加第二輪德爾菲調查,其中138人完成了問卷調查(85%);④ 召開三輪專家線上共識會對初始條目進行增減、修改或補充,為確保關鍵利益相關群體的平衡及地域多樣性,共識小組的16名專家參與討論,最終確定27個條目;⑤ 將指南及解釋性文件發給獨立于共識小組之外的16名專家,確定最終報告清單中的條目及文字表述。

圖2

DECIDE-AI制訂過程流程圖

圖2

DECIDE-AI制訂過程流程圖

3 DECIDE-AI主要內容

DECIDE-AI報告指南由17條AI相關特異性報告條目(1~17)和10條一般性報告條目(I~X)組成,包括標題和摘要、引言、方法、結果、討論和聲明六部分(表1),本文重點介紹與AI相關的特異性報告條目,條目中涉及的具體術語見表2。

3.1 題目和摘要

題目中需明確說明研究是人工智能輔助決策系統的早期臨床評價,幫助讀者快速、準確的識別和檢索研究。題目需體現:① 在輔助決策系統中使用機器學習/人工智能;② 輔助決策系統需解決的臨床問題;③ 研究階段。例如:基于人工智能的自主診斷系統在初級診療中檢測糖尿病視網膜病變的關鍵性試驗[19]。摘要部分建議使用結構式摘要,說明AI系統的預期用途、算法類型、研究環境、參與者、結局指標、安全性和人因學評價、主要結果和結論。

3.2 引言

引言部分要求說明AI系統的預期用途(或預期目的)及相關使用規范。這些信息與預期用途有關,不應與研究期間AI系統的實際使用情況相混淆,清晰描述預期用途有助于讀者評估在相關場景中使用的AI系統是否代表預期用途。同時有助于監管機構參考臨床研究中聲稱的預期用途決定新器械分類和審批。如果臨床研究的預期用途與臨床前開發階段的預期用途不同,需明確說明。

預期用途部分要描述目標疾病/健康狀況(如:敗血癥)和擬解決的問題(如:在液體和血管加壓藥劑量之間找到最佳平衡),明確定義當前針對此疾病/健康狀況的標準實踐方案及目標患者人群(條目2a)。提供有關AI系統預期實施的信息,包括可能影響用戶與AI系統交互的相關特征(如:用戶在醫療保健系統中的角色和職責、專業、培訓水平、對數字技術的熟悉程度等)、擬在臨床路徑的整合方式(使用環境、系統訪問的難易程度、輔助決策的類型與時機等)及應用系統的潛在臨床效果,對旨在改善患者醫療服務的AI系統,作者應說明針對哪些患者結局(如:30天再入院率或死亡率)(條目2b)。

3.3 方法

方法學部分重點報告以下六方面:

3.3.1 參與者

描述患者與數據層面的納入排除標準(條目3a)。患者層面的標準包括有關招募策略(在社區中主動、被動、開放招募)、抽樣方法(連續、隨機等)和知情同意(知情豁免)等信息。數據層面的標準包括采集時間、采集方法、數據質量、數據完整性和數據格式。需注意的是符合患者層面納入標準的參與者可因數據質量低或數據不完整而被排除。樣本量計算方面,AI系統臨床評價早期不要求正式統計樣本量計算,但需說明事前確定的樣本量。

與條目3a類似,作者還應詳細描述用戶的納入排除標準及招募數量(3b),由于患者和用戶都被視為參與者(見詞匯表),還應報告用戶獲得知情同意的信息。但考慮到無論何種質量的用戶數據均可提供人工智能系統可用性的信息(如:使用困難、缺乏興趣等),通常不建議設置數據層面排除標準。

學習曲線評估是評價創新AI系統的重要內容之一,作者需詳細說明為使用戶熟悉AI系統而采取的措施,如培訓課程類型、培訓次數和時間等(條目3c)。

3.3.2 人工智能系統

作者清晰描述AI系統的算法類型(即數學模型)、支持軟硬件及其版本號,說明算法訓練集中患者特征及系統在臨床前開發或離線驗證中的性能。如果上述信息無法從公開發表的文章中直接引用,建議以附件形式補充完整(條目4a)。

詳細描述輸入數據特征,包括輸入數據項清單、數據采集的時間范圍、輸入數據來源(如:常規收集數據、主動收集數據)、數據采集方式(如:計算機斷層掃描儀成像、切片計數)、數據輸入方式(如:從EHR中自動提取、手動輸入等)、數據預處理及如何定義和處理缺失值(條目4b)。

描述如何向用戶呈現AI系統的輸出結果,包括AI 系統的輸出類型和數量(如:AI系統對每個檢測到的結節進行分割并給出惡性腫瘤的概率),顯示界面的設計(如:圖像、屏幕截圖、插圖)及其他信息(如:關注機制的可視化,顯示對AI系統推薦影響最大的變量等)。作者還應說明用戶可對界面進行多大程度的定制,是否有機會讓用戶向AI系統提供交互反饋(條目4c)。

3.3.3 實施

描述評價AI系統的環境,包括醫療中心的類型和規模(如:重大創傷中心),場所(如:急診科)、相關人員和技術支持(如:多學科創傷團隊、床旁射線照相術),或AI系統支持硬件(計算機)(條目5a)。

描述研究期間如何使用人工智能系統的信息,包括與臨床工作流程/臨床路徑集成相關的信息(如:患者的初始情況及其接受治療的原因、使用AI系統做出的臨床決策)及決策過程,包括涉及哪方面的人員、處于哪個階段以及誰負責最終的臨床決策(條目5b)。

3.3.4 安全性與錯誤

說明如何明確定義和識別重大錯誤或故障,包括算法錯誤(如:錯誤的將結節描述為惡性)、支持軟硬件故障(如:因數據提取或電池電量耗盡無法生成推薦意見)及涉及用戶的錯誤(如:用戶輸入錯誤)(條目6a)。

說明如何識別、分析和最小化患者安全風險或傷害事件,包括:傷害事件發生的可能性、對參與者的潛在影響、風險檢測的難易程度及目標患者群體的疾病嚴重程度(條目6b)。

3.3.5 人因學

描述人因學使用的工具、方法或框架,設備的典型使用示例及如何選擇參與人因評估的用戶(條目7)。與安全性一樣,人因設計評估應在臨床前階段就已開展,這里主要指在臨床實時環境下的持續評估。最合適的人因設計評估取決于環境和設備,主要評價其可用性。可用性評估需使用經過驗證的工具、方法或框架,如:ISO標準(ISO

3.3.6 倫理

描述是否使用特定方法來達到與倫理相關的目標(如算法公平性),并解釋使用這些方法的理由。相關方法包括用于檢測、量化和減輕算法輸出中偏見的措施,包括但不限于算法公平性。例如,由于參考標準增加了黑人患者的估計風險,需重新調整心臟手術風險評估的算法(條目8)。

3.4 結果

3.4.1 參與者

根據AI系統的預期用途、已知對結果有影響的因素選擇要報告的基線特征(條目9a)。例如:年齡、性別、種族、社會經濟地位、地理位置、目標疾病的患病率、目標疾病的分類/嚴重程度、算法中包含的關鍵預測因子等。作者還應同時定量報告研究期間AI 系統輸入數據(條目4b)的缺失情況,最好按數據項細分。

考慮報告用戶的醫學專業、培訓水平、臨床角色/資歷、對決策的熟悉程度及他們之前是否接觸過決策輔助工具等(條目9b)。在用戶數量較少的研究中,作者還需仔細考慮如何在報告用戶基線特征時保持用戶的匿名性。

3.4.2 實施

報告實際接觸過輔助決策工具的潛在用戶比例、有權訪問該工具的用戶使用該工具的頻率、未能遵守AI系統指示使用的情況(如:適應癥、使用時間等)(條目10a)。如適用,還應簡要描述本應使用AI系統但沒有使用的情況。

報告AI系統對臨床工作流程或臨床路徑造成的任何重大變化(條目10b),注意區分臨床工作流程(即醫護人員為患者提供醫療服務時遵循的步驟和程序)和臨床路徑(即患者在與醫療系統接觸過程中經歷的系列醫療程序和活動),選擇報告那些重大變化時應考慮:① 與條目2b描述的預期用途的區別(如:AI系統原本旨在減少使用不適當的影像檢查,但意外導致專科轉診數量的增加);② 對患者安全的潛在風險;③ 對AI系統集成和接受程度的潛在影響。

3.4.3 調整

說明研究期間對AI系統做出的任何調整(條目11),包括對算法的更改(如:重新校準)或對其支持硬件平臺的更改(如:顯示界面改進)等,詳細記錄更改后的版本號及這些更改對主要研究結果的影響。

3.4.4 人機協議

輔助決策系統旨在影響用戶的決策,根據用戶對人工智能系統建議的反應,可能會出現三大情況:① 決定/行動沒有變化;② 決定/行動有所改善(凸顯人工智能系統的潛在附加值);③ 決定/行動惡化(使用人工智能系統會使患者面臨額外的風險)。作者應詳細報告用戶對AI系統的反應,描述用戶決策與AI系統建議不一致的情況及原因(條目12)。如:初始用戶決策、人工智能系統推薦、最終用戶決策、臨床情況、患者/病例特征、用戶特征、改變的原因、改變的后果等。

3.4.5 安全性及錯誤

報告所有觀察到的重大錯誤/故障(建議以表格形式列出),包括出現次數、原因、如何糾正相應錯誤/故障及對患者結局產生的影響(條目13a)。作者應根據條目6b報告出現的患者安全風險或傷害事件(條目13b)。

3.4.6 人因學

人因學評價結果的報告應以所選方法為指導(條目7),如果與用戶群體不同(或子集),則應指定人因設計評估參與者的特征(條目14a)。統計描述有助于讀者理解學習曲線的含義,圖形的方式可為讀者提供更精細的信息(條目14b)。

3.5 討論

3.5.1 支持預期用途

作者應根據結果描述對評估系統的實際預期,及這些結果如何支持系統的預期用途,并與當前標準實踐方案和類似研究進行比較(條目15)。結合人因設計評估結果討論關鍵臨床表現的結果,同時說明在采用AI系統開展下一階段更大規模比較試驗時可能存在的挑戰。

3.5.2 安全性及錯誤

作者應結合錯誤/故障、已識別的風險、觀察到的不良事件、臨床路徑的意外變化及與安全相關的人因技術評估結果總結該研究的主要安全發現,并提出可能的解決方案,如:算法再訓練、產品再開發或修改后續試驗設計等(條目16)。

3.6 聲明(數據可獲得性)

說明能否公開獲取算法和相關支持軟件代碼,如不能,需說明原因,若能,應說明獲取途徑(條目17)。

4 小結

大數據時代下,AI臨床輔助決策系統在國內的應用愈發廣泛,如新冠期間深圳大學醫學部吳光耀教授團隊開發的用于新冠肺炎患者入院時風險評估的輔助決策系統[25];北京天壇醫院李子孝教授團隊開發的腦血管疾病AI臨床輔助決策系統[26];中國臨床腫瘤學會開發的CSSO人工智能輔助決策系統等[27]。DECIDE-AI指南經系統文獻綜述、專家咨詢和國際專家共識會等步驟制訂而成,綜合各利益相關方建議,從AI輔助決策系統的預期用途、參與者、AI算法、實施與應用、安全性與錯誤、人因學分析等方面為AI系統早期臨床評價研究的報告提供強有力的指導,有助于提高AI系統早期臨床評價研究報告的清晰度和透明度,并在研究設計、方案起草、研究注冊中為研究者提供方法學支持,促進AI系統的臨床應用。

需注意的是:① AI系統的早期科學評估與監管在內容上存在一定程度的重合,但考慮到科學評估和監管評估的重點略有不同且國家間的監管策略存在差異[28],該指南中未涉及監管內容,對監管的指導意義有限;② AI系統輸出結果的可解釋性對提高用戶和患者對AI系統的信任度及擴大實際應用范圍至關重要[29],但在共識過程中有專家認為AI系統的臨床價值可能與可解釋性無關,另外,由于目前尚缺少普遍接受的量化或評價可解釋性的方法,共識小組最終決定在本指南中暫不列入與可解釋性相關的條目;③ 隨著用戶積累AI系統的實際使用經驗,其對AI系統推薦結果的信任度也會發生變化,了解信任度的變化趨勢,有助于制訂用戶培訓計劃和確定比較試驗中數據收集的最佳時間點,但與可解釋性一樣,因目前缺少達成共識的評價方法,本報告指南中暫未考慮信任度變化的問題。

DECIDE-AI是不同專業背景、經驗專家共識的結果,為人工智能輔助決策系統的早期臨床評價提供最低報告標準,適用于該階段所有研究設計類型和AI功能模式(檢測、診斷、預后、治療)的報告,但仍有局限性:① 雖然共識專家的選擇以地域、專業多樣化為原則,但仍存在地域(以歐洲為主)和利益相關群體(以臨床醫生和工程師為主)的不均衡,可能導致參與者選擇偏倚;② 與其他AI系統報告規范類似,AI系統早期臨床評估的研究示例很少,可能影響從文獻中提取初始條目的完整性,研究小組也是通過兩輪德爾菲咨詢盡量完善、補充條目;③ 目前該報告規范還處于實踐初期,后期在真實世界更廣泛群體中的應用將會促進條目的修改與完善。

綜上,將人工智能引入醫療系統需得到完整、可靠及全面的證據支持,有助于確保人工智能系統的安全性和有效性及獲得患者、從業者和購買者的信任。DECIDE-AI旨在改善AI系統早期臨床評價的報告,為后期更大規模的臨床研究和廣泛應用奠定基礎。

1 DECIDE-AI的制訂背景

近年來,人工智能(artificial intelligence,AI)在醫療服務領域的應用愈發廣泛,基于AI的臨床決策輔助系統(以下簡稱“AI系統”)是其主要應用形式之一。研究表明:AI系統在臨床前開發階段或計算機生物模擬階段已展現出可比擬人類專家的良好性能[1],但少有證據證明其在臨床實際應用中能改善醫生活動和患者結局[2,3]。目前,AI系統的開發與應用間尚存在的“AI鴻溝”[4],即主要強調人工智能算法的數學性能,忽略了人工智能系統、用戶和實施環境間相互作用對其實際應用的影響。將人工智能系統從數學性能提升到臨床效果,需開展循序漸進的實施和評估,解決其相互作用的復雜問題。

AI系統的早期臨床評價介于臨床前開發(計算機模擬)、離線驗證和臨床試驗之間,類似于外科領域IDEAL框架的stage 1(設想)、2a(開發)或2b(探索)[5,6],或藥物臨床試驗的1期與2期臨床試驗(圖1),關注AI系統的實際臨床性能、安全性和人因學評價(human factors)。但目前少有AI系統臨床研究涉及人因學評價,且可用性評估方法不一致。另外,也缺少AI系統運行環境、用戶特征、選擇過程及算法識別等方面的報告。

圖1

藥物、醫療衛生領域中人工智能和外科創新的發展路徑比較

圖1

藥物、醫療衛生領域中人工智能和外科創新的發展路徑比較

彩色線條代表報告指南,其中部分是針對特定研究設計的(TRIPOD-AI、STARD-AI、SPIRIT/CONSORT、SPIRIT/CONSORT-AI),部分是針對特定階段的(DECIDE-AI、IDEAL)。

為提高AI系統臨床研究的透明性和規范性,國際上已相繼制訂和發布相關報告規范,如:用于報告診斷或預后預測模型開發、驗證和更新的TRIPOD-AI[7];用于報告診斷準確性研究的STARD-AI[8];分別用于報告評價隨機對照試驗及計劃書的CONSORT-AI[9]和SPIRIT-AI[10](圖1),但AI系統早期臨床評價階段的報告規范仍存在空白。為改善實踐中此類研究報告不充分的問題,2022年5月,Vasey等[11]在BMJ發表了人工智能驅動下決策輔助系統早期臨床評價的報告指南(reporting guideline for the developmental and exploratory clinical investigations of decision support systems driven by artificial intelligence,DECIDE-AI)。本文就指南的制訂過程和主要內容進行解讀,以期促進報告指南的正確理解和使用。

2 DECIDE-AI的制訂過程

DECIDE-AI的制訂參考EQUATOR協作網指南制訂的基本流程進行,有專門的指導小組監督指南的制訂過程[12],見圖2:① 基于專家意見制訂了初步的候選清單,該清單重點參考了基于人工智能診斷決策輔助系統的相關文獻、指導小組成員推薦的文獻及監管機構文件;② 通過不同的渠道招募專家,包括:指導小組推薦的專家、檢獲文獻的作者、任何主動聯系指導小組的專家及德爾菲專家推薦的專家(滾雪球),最終招募了行政人員/醫院管理人員、醫療專業人員、臨床醫生、工程師/計算機科學家、人因設計專家、流行病學家、倫理學家、期刊編輯、患者代表等來自18個國家的20類利益相關群體參與;③ 開展兩輪改良德爾菲專家咨詢形成初步條目,138名專家同意參加首輪德爾菲調查,其中123名(89%)完成了調查問卷,162名專家受邀參加第二輪德爾菲調查,其中138人完成了問卷調查(85%);④ 召開三輪專家線上共識會對初始條目進行增減、修改或補充,為確保關鍵利益相關群體的平衡及地域多樣性,共識小組的16名專家參與討論,最終確定27個條目;⑤ 將指南及解釋性文件發給獨立于共識小組之外的16名專家,確定最終報告清單中的條目及文字表述。

圖2

DECIDE-AI制訂過程流程圖

圖2

DECIDE-AI制訂過程流程圖

3 DECIDE-AI主要內容

DECIDE-AI報告指南由17條AI相關特異性報告條目(1~17)和10條一般性報告條目(I~X)組成,包括標題和摘要、引言、方法、結果、討論和聲明六部分(表1),本文重點介紹與AI相關的特異性報告條目,條目中涉及的具體術語見表2。

3.1 題目和摘要

題目中需明確說明研究是人工智能輔助決策系統的早期臨床評價,幫助讀者快速、準確的識別和檢索研究。題目需體現:① 在輔助決策系統中使用機器學習/人工智能;② 輔助決策系統需解決的臨床問題;③ 研究階段。例如:基于人工智能的自主診斷系統在初級診療中檢測糖尿病視網膜病變的關鍵性試驗[19]。摘要部分建議使用結構式摘要,說明AI系統的預期用途、算法類型、研究環境、參與者、結局指標、安全性和人因學評價、主要結果和結論。

3.2 引言

引言部分要求說明AI系統的預期用途(或預期目的)及相關使用規范。這些信息與預期用途有關,不應與研究期間AI系統的實際使用情況相混淆,清晰描述預期用途有助于讀者評估在相關場景中使用的AI系統是否代表預期用途。同時有助于監管機構參考臨床研究中聲稱的預期用途決定新器械分類和審批。如果臨床研究的預期用途與臨床前開發階段的預期用途不同,需明確說明。

預期用途部分要描述目標疾病/健康狀況(如:敗血癥)和擬解決的問題(如:在液體和血管加壓藥劑量之間找到最佳平衡),明確定義當前針對此疾病/健康狀況的標準實踐方案及目標患者人群(條目2a)。提供有關AI系統預期實施的信息,包括可能影響用戶與AI系統交互的相關特征(如:用戶在醫療保健系統中的角色和職責、專業、培訓水平、對數字技術的熟悉程度等)、擬在臨床路徑的整合方式(使用環境、系統訪問的難易程度、輔助決策的類型與時機等)及應用系統的潛在臨床效果,對旨在改善患者醫療服務的AI系統,作者應說明針對哪些患者結局(如:30天再入院率或死亡率)(條目2b)。

3.3 方法

方法學部分重點報告以下六方面:

3.3.1 參與者

描述患者與數據層面的納入排除標準(條目3a)。患者層面的標準包括有關招募策略(在社區中主動、被動、開放招募)、抽樣方法(連續、隨機等)和知情同意(知情豁免)等信息。數據層面的標準包括采集時間、采集方法、數據質量、數據完整性和數據格式。需注意的是符合患者層面納入標準的參與者可因數據質量低或數據不完整而被排除。樣本量計算方面,AI系統臨床評價早期不要求正式統計樣本量計算,但需說明事前確定的樣本量。

與條目3a類似,作者還應詳細描述用戶的納入排除標準及招募數量(3b),由于患者和用戶都被視為參與者(見詞匯表),還應報告用戶獲得知情同意的信息。但考慮到無論何種質量的用戶數據均可提供人工智能系統可用性的信息(如:使用困難、缺乏興趣等),通常不建議設置數據層面排除標準。

學習曲線評估是評價創新AI系統的重要內容之一,作者需詳細說明為使用戶熟悉AI系統而采取的措施,如培訓課程類型、培訓次數和時間等(條目3c)。

3.3.2 人工智能系統

作者清晰描述AI系統的算法類型(即數學模型)、支持軟硬件及其版本號,說明算法訓練集中患者特征及系統在臨床前開發或離線驗證中的性能。如果上述信息無法從公開發表的文章中直接引用,建議以附件形式補充完整(條目4a)。

詳細描述輸入數據特征,包括輸入數據項清單、數據采集的時間范圍、輸入數據來源(如:常規收集數據、主動收集數據)、數據采集方式(如:計算機斷層掃描儀成像、切片計數)、數據輸入方式(如:從EHR中自動提取、手動輸入等)、數據預處理及如何定義和處理缺失值(條目4b)。

描述如何向用戶呈現AI系統的輸出結果,包括AI 系統的輸出類型和數量(如:AI系統對每個檢測到的結節進行分割并給出惡性腫瘤的概率),顯示界面的設計(如:圖像、屏幕截圖、插圖)及其他信息(如:關注機制的可視化,顯示對AI系統推薦影響最大的變量等)。作者還應說明用戶可對界面進行多大程度的定制,是否有機會讓用戶向AI系統提供交互反饋(條目4c)。

3.3.3 實施

描述評價AI系統的環境,包括醫療中心的類型和規模(如:重大創傷中心),場所(如:急診科)、相關人員和技術支持(如:多學科創傷團隊、床旁射線照相術),或AI系統支持硬件(計算機)(條目5a)。

描述研究期間如何使用人工智能系統的信息,包括與臨床工作流程/臨床路徑集成相關的信息(如:患者的初始情況及其接受治療的原因、使用AI系統做出的臨床決策)及決策過程,包括涉及哪方面的人員、處于哪個階段以及誰負責最終的臨床決策(條目5b)。

3.3.4 安全性與錯誤

說明如何明確定義和識別重大錯誤或故障,包括算法錯誤(如:錯誤的將結節描述為惡性)、支持軟硬件故障(如:因數據提取或電池電量耗盡無法生成推薦意見)及涉及用戶的錯誤(如:用戶輸入錯誤)(條目6a)。

說明如何識別、分析和最小化患者安全風險或傷害事件,包括:傷害事件發生的可能性、對參與者的潛在影響、風險檢測的難易程度及目標患者群體的疾病嚴重程度(條目6b)。

3.3.5 人因學

描述人因學使用的工具、方法或框架,設備的典型使用示例及如何選擇參與人因評估的用戶(條目7)。與安全性一樣,人因設計評估應在臨床前階段就已開展,這里主要指在臨床實時環境下的持續評估。最合適的人因設計評估取決于環境和設備,主要評價其可用性。可用性評估需使用經過驗證的工具、方法或框架,如:ISO標準(ISO

3.3.6 倫理

描述是否使用特定方法來達到與倫理相關的目標(如算法公平性),并解釋使用這些方法的理由。相關方法包括用于檢測、量化和減輕算法輸出中偏見的措施,包括但不限于算法公平性。例如,由于參考標準增加了黑人患者的估計風險,需重新調整心臟手術風險評估的算法(條目8)。

3.4 結果

3.4.1 參與者

根據AI系統的預期用途、已知對結果有影響的因素選擇要報告的基線特征(條目9a)。例如:年齡、性別、種族、社會經濟地位、地理位置、目標疾病的患病率、目標疾病的分類/嚴重程度、算法中包含的關鍵預測因子等。作者還應同時定量報告研究期間AI 系統輸入數據(條目4b)的缺失情況,最好按數據項細分。

考慮報告用戶的醫學專業、培訓水平、臨床角色/資歷、對決策的熟悉程度及他們之前是否接觸過決策輔助工具等(條目9b)。在用戶數量較少的研究中,作者還需仔細考慮如何在報告用戶基線特征時保持用戶的匿名性。

3.4.2 實施

報告實際接觸過輔助決策工具的潛在用戶比例、有權訪問該工具的用戶使用該工具的頻率、未能遵守AI系統指示使用的情況(如:適應癥、使用時間等)(條目10a)。如適用,還應簡要描述本應使用AI系統但沒有使用的情況。

報告AI系統對臨床工作流程或臨床路徑造成的任何重大變化(條目10b),注意區分臨床工作流程(即醫護人員為患者提供醫療服務時遵循的步驟和程序)和臨床路徑(即患者在與醫療系統接觸過程中經歷的系列醫療程序和活動),選擇報告那些重大變化時應考慮:① 與條目2b描述的預期用途的區別(如:AI系統原本旨在減少使用不適當的影像檢查,但意外導致專科轉診數量的增加);② 對患者安全的潛在風險;③ 對AI系統集成和接受程度的潛在影響。

3.4.3 調整

說明研究期間對AI系統做出的任何調整(條目11),包括對算法的更改(如:重新校準)或對其支持硬件平臺的更改(如:顯示界面改進)等,詳細記錄更改后的版本號及這些更改對主要研究結果的影響。

3.4.4 人機協議

輔助決策系統旨在影響用戶的決策,根據用戶對人工智能系統建議的反應,可能會出現三大情況:① 決定/行動沒有變化;② 決定/行動有所改善(凸顯人工智能系統的潛在附加值);③ 決定/行動惡化(使用人工智能系統會使患者面臨額外的風險)。作者應詳細報告用戶對AI系統的反應,描述用戶決策與AI系統建議不一致的情況及原因(條目12)。如:初始用戶決策、人工智能系統推薦、最終用戶決策、臨床情況、患者/病例特征、用戶特征、改變的原因、改變的后果等。

3.4.5 安全性及錯誤

報告所有觀察到的重大錯誤/故障(建議以表格形式列出),包括出現次數、原因、如何糾正相應錯誤/故障及對患者結局產生的影響(條目13a)。作者應根據條目6b報告出現的患者安全風險或傷害事件(條目13b)。

3.4.6 人因學

人因學評價結果的報告應以所選方法為指導(條目7),如果與用戶群體不同(或子集),則應指定人因設計評估參與者的特征(條目14a)。統計描述有助于讀者理解學習曲線的含義,圖形的方式可為讀者提供更精細的信息(條目14b)。

3.5 討論

3.5.1 支持預期用途

作者應根據結果描述對評估系統的實際預期,及這些結果如何支持系統的預期用途,并與當前標準實踐方案和類似研究進行比較(條目15)。結合人因設計評估結果討論關鍵臨床表現的結果,同時說明在采用AI系統開展下一階段更大規模比較試驗時可能存在的挑戰。

3.5.2 安全性及錯誤

作者應結合錯誤/故障、已識別的風險、觀察到的不良事件、臨床路徑的意外變化及與安全相關的人因技術評估結果總結該研究的主要安全發現,并提出可能的解決方案,如:算法再訓練、產品再開發或修改后續試驗設計等(條目16)。

3.6 聲明(數據可獲得性)

說明能否公開獲取算法和相關支持軟件代碼,如不能,需說明原因,若能,應說明獲取途徑(條目17)。

4 小結

大數據時代下,AI臨床輔助決策系統在國內的應用愈發廣泛,如新冠期間深圳大學醫學部吳光耀教授團隊開發的用于新冠肺炎患者入院時風險評估的輔助決策系統[25];北京天壇醫院李子孝教授團隊開發的腦血管疾病AI臨床輔助決策系統[26];中國臨床腫瘤學會開發的CSSO人工智能輔助決策系統等[27]。DECIDE-AI指南經系統文獻綜述、專家咨詢和國際專家共識會等步驟制訂而成,綜合各利益相關方建議,從AI輔助決策系統的預期用途、參與者、AI算法、實施與應用、安全性與錯誤、人因學分析等方面為AI系統早期臨床評價研究的報告提供強有力的指導,有助于提高AI系統早期臨床評價研究報告的清晰度和透明度,并在研究設計、方案起草、研究注冊中為研究者提供方法學支持,促進AI系統的臨床應用。

需注意的是:① AI系統的早期科學評估與監管在內容上存在一定程度的重合,但考慮到科學評估和監管評估的重點略有不同且國家間的監管策略存在差異[28],該指南中未涉及監管內容,對監管的指導意義有限;② AI系統輸出結果的可解釋性對提高用戶和患者對AI系統的信任度及擴大實際應用范圍至關重要[29],但在共識過程中有專家認為AI系統的臨床價值可能與可解釋性無關,另外,由于目前尚缺少普遍接受的量化或評價可解釋性的方法,共識小組最終決定在本指南中暫不列入與可解釋性相關的條目;③ 隨著用戶積累AI系統的實際使用經驗,其對AI系統推薦結果的信任度也會發生變化,了解信任度的變化趨勢,有助于制訂用戶培訓計劃和確定比較試驗中數據收集的最佳時間點,但與可解釋性一樣,因目前缺少達成共識的評價方法,本報告指南中暫未考慮信任度變化的問題。

DECIDE-AI是不同專業背景、經驗專家共識的結果,為人工智能輔助決策系統的早期臨床評價提供最低報告標準,適用于該階段所有研究設計類型和AI功能模式(檢測、診斷、預后、治療)的報告,但仍有局限性:① 雖然共識專家的選擇以地域、專業多樣化為原則,但仍存在地域(以歐洲為主)和利益相關群體(以臨床醫生和工程師為主)的不均衡,可能導致參與者選擇偏倚;② 與其他AI系統報告規范類似,AI系統早期臨床評估的研究示例很少,可能影響從文獻中提取初始條目的完整性,研究小組也是通過兩輪德爾菲咨詢盡量完善、補充條目;③ 目前該報告規范還處于實踐初期,后期在真實世界更廣泛群體中的應用將會促進條目的修改與完善。

綜上,將人工智能引入醫療系統需得到完整、可靠及全面的證據支持,有助于確保人工智能系統的安全性和有效性及獲得患者、從業者和購買者的信任。DECIDE-AI旨在改善AI系統早期臨床評價的報告,為后期更大規模的臨床研究和廣泛應用奠定基礎。